B60 和 B50 用的是同一顆 Battlemage G21 晶片,media engine 一樣,SR-IOV 支援一樣,差別就是 VRAM:B60 24GB,B50 16GB。這個差距在某些工作上其實蠻具體的,在某些工作上又幾乎感覺不到。 兩張卡都在同一台 host 上跑,所以比較數字反映的是卡本身的差異,不是平台造成的。 測試平台 Host OS: Proxmox VE,Debian GNU/Linux 13 (trixie),kernel 6.17.13-2-pve CPU: AMD EPYC 平台(雙插槽) RAM: 128GB ECC Driver stack: xe B60: Intel Arc Pro B60 24GB(PCI ID 8086:e211,sriov_totalvfs=7) B50: Intel Arc Pro B50 16GB(PCI ID 8086:e212,sriov_totalvfs=2) Container images: vllm-xpu-env(vLLM 0.17.2.dev,本地自建)、linuxserver/ffmpeg:latest […]

Cloud

告別 ingress-nginx:Cilium Gateway API 遷移筆記

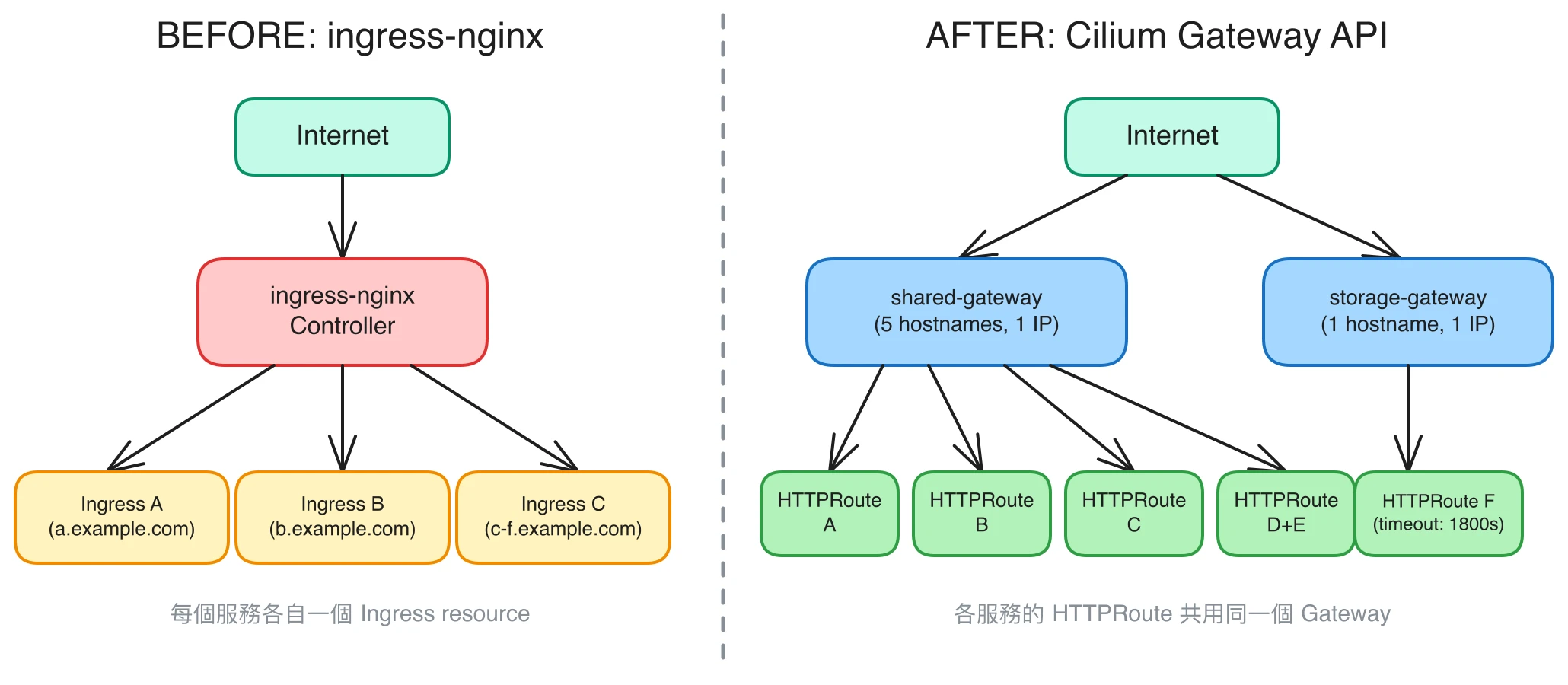

前陣子看到 ingress-nginx 宣布 deprecated,其實也不太意外,Kubernetes 官方推 Gateway API 也推了好一陣子了。我的叢集上跑著六個服務,一直都是用 ingress-nginx 做路由,於是趁這個機會全部遷移到 Cilium Gateway API。 本文記錄遷移過程和途中踩到的幾個坑。 環境 CNI:Cilium v1.18.6 TLS:cert-manager(Helm) DNS-01 Provider:Cloudflare Gateway API 快速介紹 在開始之前先簡單說明 Gateway API 的三個主要資源,不然後面看 YAML 會有點迷失。 GatewayClass 定義 Gateway 的實作方式,概念上類似 Ingress 的 ingressClassName。Cilium 安裝後會自動建立一個叫 cilium 的 GatewayClass。 Gateway 代表一個實際的 load balancer。一個 Gateway 可以有多個 listener,每個 listener 對應一個 port/protocol/hostname 的組合。 HTTPRoute 定義路由規則,指定流量要送到哪個 Service。跟 Ingress […]

在 Arista 交換機上部署 Prometheus 監控系統

概述 本文將介紹如何在 Arista 交換機上使用 Docker 容器運行 node_exporter 和 snmp_exporter,以實現透過 Prometheus 監控交換機狀態的功能。

- Cloud

- ...

在 Kubernetes 上利用 Nvidia GPU 部署 LLM Chatbot

隨著人工智慧技術的快速發展,越來越多的企業和開發者希望在自己的系統中整合語言模型聊天機器人(LLM Chatbot)。本文旨在引導讀者如何在 Kubernetes 環境中使用 Nvidia GPU,來部署一個高效能的 LLM Chatbot,從安裝必要的驅動和工具到具體的部署步驟,逐一介紹。

部署 Charmed Kubernetes with OpenStack Integrator

前言 Charmed Kuberenetes 是 Canonical 提供的 Kubernetes 部署方式,可以透過 juju 將 Kubernetes 部署至各種不同環境。 本篇將介紹如何部署 Charmed Kubernetes 至 OpenStack 上,並且利用 OpenStack Integrator 使用 OpenStack 提供 Persistent Volume 和 Load Balancer 給 Kubernetes 使用。

- Cloud

- ...

快速部署 Kubernetes 叢集:使用 kops 在 OpenStack 上的實踐指南

Kubernetes 提供多種部署選擇,而在眾多工具中,kops 以其易用性及高整合性脫穎而出。本文將深入介紹 kops 工具,並透過實際操作引導讀者在 OpenStack 環境中迅速建立一個 Kubernetes 叢集。

- Cloud

- ...

Kubernetes Cluster-API 介紹

Kubernetes 在雲原生世界發展這麼多年,也發展出了很多管理其集群生命週期的相關專案,如 kops, Rancher 等。而 VMware 則發起了一個名為 Cluster-API 的專案來利用 Kubernetes 本身的功能管理其他 Kubernetes 集群。本篇文章將會來簡單介紹 Cluster-API 這個專案。

- Cloud

- ...

透過 Ingress Nginx 公開 TCP/UDP 服務

Ingress Nginx 在 Kubernetes 中常被利用來提供網頁服務的反向代理和 load balancing。在一些狀況下,你可能會需要同一個 IP 也能夠提供其他 TCP/UDP 服務。這篇文章將會介紹在這種狀況下如何透過 Ingress Nginx 來作為 TCP/UDP 服務的 proxy。

從裸機到雲端:OpenStack 部屬工具 3

上一篇我們介紹了兩個有強大廠商後盾的部屬工具,本偏要介紹大多為社群成員維護的部屬專案,OpenStack-Ansible, Kolla-Ansible, OpenStack-Helm OpenStack-Ansible OpenStack-Ansible 就如其名,就是透過 Ansible 去部屬 OpenStack 的工具,其中支援非常多 OpenStack 元件以及不同的 Plugin。 OpenStack Ansible 主要透過 lxc container + Ansible-playbook 來安裝 OpenStack,其中有部分 service 並沒有放在 lxc container 中,如 nova-compute。 在 network plugin 的支援也是今天介紹的 3 個部屬工具中最多的,其中包含了在一些特殊環境下很好用的 Calico。 OpenStack Ansible 除了部屬 OpenStack 以外,同時也可以在部屬 OpenStack 儲存所需要使用的 Ceph,而其他專案如 Kolla-Ansible 的 Ceph cluster 就要額外自己部屬並且透過 config overwrite 去設定。 Kolla-Ansible Kolla-Ansible 是本次系列文章所選用的部屬工具,跟 OpenStack-Ansible […]

從裸機到雲端:OpenStack 部屬工具 2

上一篇我們介紹了 DevStack 跟 MicroStack 這兩個非常容易上手但是比較偏向開發測試使用的部屬方式。今天筆者會來介紹 TripleO 跟 OpenStack Charms 這兩個有強大廠商後盾的部屬工具 TripleO TripleO 是 "OpenStack on OpenStack" 的縮寫。它是 OpenStack 中其中一個 project,其主要功能就是透過 OpenStack 的一些元件幫你部屬以及維運一個可用於實際生產環境的 OpenStack Cloud。 目前 TripleO 主要由 RedHat 維護,也是 RedHat OpenStack Platform (RHOSP) 的上游部屬專案 架構概覽 如剛剛所提到的,TripleO 是 "OpenStack on OpenStack",亦即是你會有兩個 OpenStack 環境。其中一個環境我們稱之為 undercloud。Undercloud 包含了一些必要的 OpenStack 元件用來部屬我們的 overcloud。Overcloud 是 undercloud deploy 出來的 OpenStack cluster,可以被用來 production, staging, […]